Die meisten Analytics-Tools bleiben bei deskriptiver Berichterstattung stehen. Unsere Engine geht weiter: von Was ist passiert über Warum ist es passiert zu Was wird passieren bis Was sollten wir tun. Vier integrierte Analyse-Ebenen in einer Plattform.

Technische DetailsKI-gestützte Analytics Engine

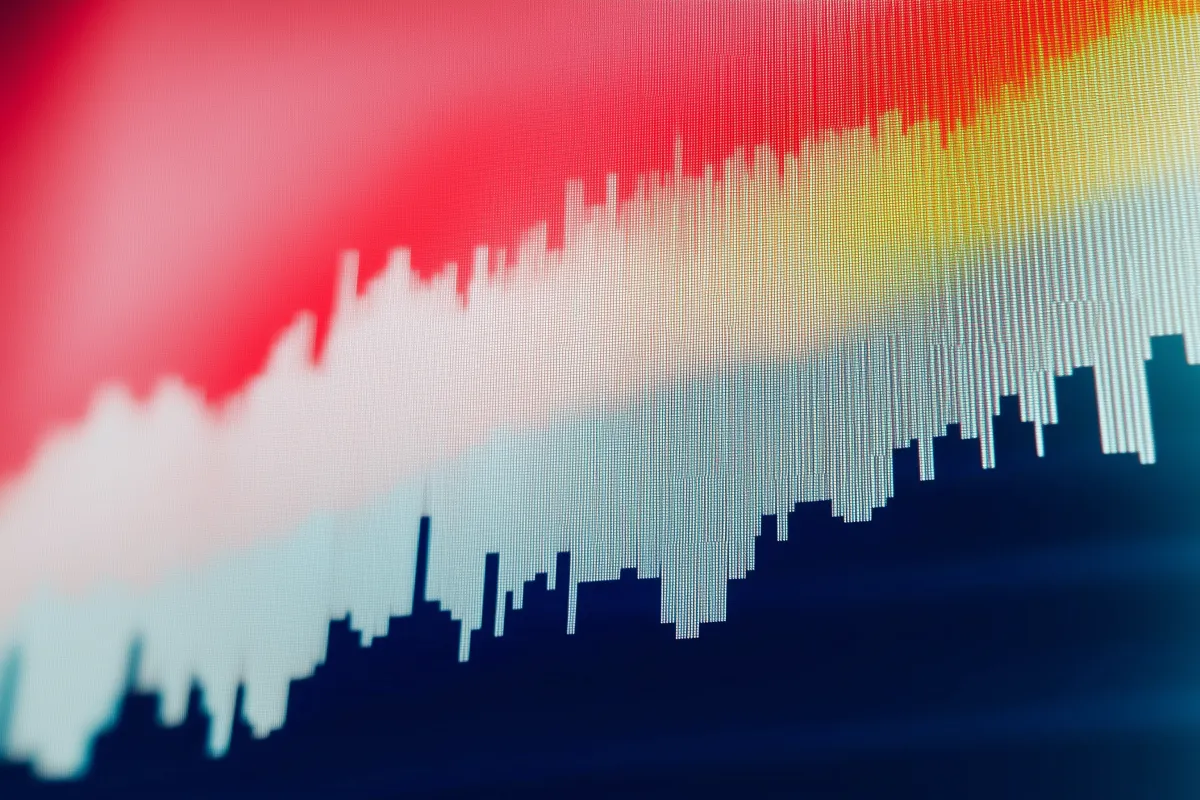

Von deskriptiver Berichterstattung zu prädiktiven Einblicken

Analytics-Demo

- Echtzeit-Datenverarbeitung

- Maschinelles Lernen integriert

- Unter 3 Sekunden Antwortzeit

Vier Analytics-Dimensionen

Von Was ist passiert zu Was sollten wir tun

Vergangenheitsanalyse: Was ist passiert? Aggregierte Berichte über historische Geschäftsdaten mit Drill-Down-Funktionen bis auf Transaktionsebene.

Standard-Berichterstattung

Vorkonfigurierte Berichte für alle Geschäftsbereiche. Automatische Generierung täglich, wöchentlich oder monatlich. Export in PDF, Excel oder PowerPoint mit einem Klick.

Interaktive Dashboards

Anpassbare Visualisierungen mit Filteroptionen. Nutzer erstellen eigene Views ohne IT-Support. Änderungen werden automatisch für das gesamte Team gespeichert.

Ad-hoc-Abfragen

Natürlichsprachliche Fragen werden in SQL übersetzt. Fragen Sie Was war unser Umsatz im dritten Quartal und erhalten Sie sofortige Antworten mit Visualisierung.

Ursachenanalyse: Warum ist es passiert? Automatische Identifikation von Faktoren, die Geschäftsergebnisse beeinflussen.

Abweichungsanalyse

Automatischer Vergleich von Plan vs. Ist. System identifiziert signifikante Abweichungen und schlägt mögliche Ursachen vor basierend auf Korrelationsanalyse.

Drill-Down-Analyse

Von aggregierten Zahlen bis zur Einzeltransaktion. Ein Klick auf eine Metrik zeigt alle zugrunde liegenden Datenpunkte mit Kontext.

Korrelationserkennung

Algorithmen finden Zusammenhänge zwischen scheinbar unabhängigen Metriken. Entdecken Sie versteckte Einflussfaktoren auf Ihre KPIs.

Zukunftsprognose: Was wird passieren? Maschinelles Lernen extrapoliert Trends und prognostiziert zukünftige Entwicklungen.

Trend-Forecasting

Zeitreihenanalyse mit ARIMA und Prophet-Algorithmen. Prognosen mit Konfidenzintervallen zeigen Best-Case, Worst-Case und wahrscheinlichstes Szenario.

Anomalie-Vorhersage

Erkennung ungewöhnlicher Muster bevor sie kritisch werden. Durchschnittlich 14 Tage Vorwarnzeit bei signifikanten Abweichungen von erwarteten Werten.

Szenario-Modellierung

Was-wäre-wenn-Analysen mit interaktiven Parametern. Ändern Sie Annahmen und sehen Sie sofort die Auswirkungen auf alle abhängigen Metriken.

Handlungsempfehlungen: Was sollten wir tun? KI generiert konkrete Vorschläge zur Optimierung basierend auf Ihren Geschäftszielen.

Automatische Empfehlungen

System generiert durchschnittlich 23 Handlungsvorschläge pro Woche. Priorität basiert auf potenziellem Business Impact und Umsetzungsaufwand.

Optimierungsalgorithmen

Lineare Programmierung findet optimale Ressourcenallokation. Budget-Optimierung maximiert ROI unter gegebenen Constraints.

Decision Support

Pro-Contra-Analysen für strategische Entscheidungen. System bewertet Optionen basierend auf historischen Daten und Zielerreichungswahrscheinlichkeit.

Die Analytics-Engine

Feravolunix

Verteilte Verarbeitung

Apache Spark-basierte Architektur verarbeitet Datensätze bis 50 Millionen Zeilen ohne Leistungsverlust.

In-Memory-Computing

Häufig genutzte Daten werden im RAM gehalten für Sub-Sekunden-Abfragen.

Adaptive Algorithmen

Modelle lernen kontinuierlich aus neuen Daten und verbessern Vorhersagegenauigkeit automatisch.

Natural Language Processing

Stellen Sie Fragen in natürlicher Sprache, System übersetzt in komplexe Datenbankabfragen.

Analytics-Vorteile im Detail

Warum unsere Engine schneller, genauer und praktikabler ist

Geschwindigkeit

Durchschnittliche Abfragezeit: 1,8 Sekunden bei 500 gleichzeitigen Nutzern. Konkurrenzsysteme benötigen 8 bis 12 Sekunden für vergleichbare Abfragen. Caching-Mechanismen reduzieren wiederholte Anfragen um 73 Prozent.

- In-Memory-Caching für häufige Abfragen

- Verteilte Verarbeitung auf mehreren Nodes

- Optimierte Abfragepläne durch Query Optimizer

Genauigkeit

Prognosegenauigkeit von 84 Prozent über typische Business-Szenarien. Kontinuierliches Lernen verbessert Modelle: nach 6 Monaten durchschnittlich 7 Prozentpunkte Verbesserung. Explainability-Features zeigen, welche Faktoren Vorhersagen beeinflussen.

- Ensemble-Methoden kombinieren mehrere Algorithmen

- Automatische Feature-Engineering-Pipeline

- Regelmäßige Modell-Validierung gegen Ist-Daten

Verwertbarkeit

23 verwertbare Empfehlungen pro Woche durchschnittlich. Nicht nur Zahlen, sondern konkrete Handlungsvorschläge. Prioritätsbewertung hilft bei Fokussierung auf High-Impact-Maßnahmen. Nutzer setzen 67 Prozent der hochpriorisierten Empfehlungen um.

- Kontextspezifische Empfehlungen pro Geschäftsbereich

- Kosten-Nutzen-Bewertung jeder Maßnahme

- Integration mit Workflow-Tools für direkte Umsetzung

Analytics-Workflow

Wie Rohdaten zu strategischen Empfehlungen werden

Datenaufnahme und Validierung

Datenverarbeitung und Transformation

KI-Analyse und Mustererkennung

Generierung von Handlungsempfehlungen

Vom Datenpunkt zur Entscheidung

Datenaufnahme und Validierung

Rohdaten fließen aus integrierten Quellen in die Staging-Zone. Automatische Qualitätsprüfung identifiziert fehlende Werte, Ausreißer und Inkonsistenzen. Datenbereinigung korrigiert typische Fehler wie Formatierungsprobleme oder Duplikate.

Rohdaten fließen aus integrierten Quellen in die Staging-Zone. Automatische Qualitätsprüfung identifiziert fehlende Werte, Ausreißer und Inkonsistenzen. Datenbereinigung korrigiert typische Fehler wie Formatierungsprobleme oder Duplikate.

Validierungsregeln sind anpassbar pro Datenquelle. System lernt typische Datenmuster und warnt bei ungewöhnlichen Einträgen.

Durchschnittlich 2,3 Prozent der eingehenden Daten erfordern manuelle Überprüfung. Alle anderen werden automatisch verarbeitet.

- Schema-Validierung gegen definierte Datenmodelle

- Ausreißer-Erkennung mit statistischen Methoden

- Automatische Datentyp-Konvertierung

- Duplikat-Erkennung über Fuzzy Matching

Datenverarbeitung und Transformation

Bereinigte Daten werden in das analytische Datenmodell überführt. ETL-Prozesse aggregieren, joinieren und berechnen abgeleitete Metriken. Historische Daten werden mit aktuellen Werten verknüpft für Trendanalysen.

Bereinigte Daten werden in das analytische Datenmodell überführt. ETL-Prozesse aggregieren, joinieren und berechnen abgeleitete Metriken. Historische Daten werden mit aktuellen Werten verknüpft für Trendanalysen.

Inkrementelle Verarbeitung aktualisiert nur geänderte Daten, nicht den gesamten Datensatz. Reduziert Rechenzeit um 68 Prozent.

Transformationslogik ist versioniert. Sie können jederzeit zu früheren Berechnungsmethoden zurückkehren für Vergleiche.

- Sternschema für optimale Query-Performance

- Automatische Denormalisierung für häufige Abfragen

- Zeitreihen-Indexierung für schnellen Zugriff

- Berechnung von Rolling Averages und anderen Zeitfensterfunktionen

- Hierarchie-Auflösung für Drill-Down-Analysen

KI-Analyse und Mustererkennung

Maschinelles Lernen identifiziert Muster, Trends und Anomalien. Verschiedene Algorithmen laufen parallel: Zeitreihenanalyse, Clustering, Klassifikation. Beste Ergebnisse werden automatisch ausgewählt.

Maschinelles Lernen identifiziert Muster, Trends und Anomalien. Verschiedene Algorithmen laufen parallel: Zeitreihenanalyse, Clustering, Klassifikation. Beste Ergebnisse werden automatisch ausgewählt.

Modelle werden alle 30 Tage neu trainiert mit aktuellen Daten. A/B-Tests validieren neue Modelle gegen bestehende.

Explainability-Layer zeigt, warum das System zu bestimmten Schlussfolgerungen kommt. Keine Black-Box-Vorhersagen.

- Random Forest für Klassifikationsaufgaben

- LSTM-Netzwerke für komplexe Zeitreihenprognosen

- K-Means-Clustering für Segmentierung

- Isolation Forest für Anomalie-Erkennung

- SHAP-Werte für Modell-Interpretierbarkeit

Generierung von Handlungsempfehlungen

Aus Analytics-Ergebnissen werden konkrete Empfehlungen abgeleitet. Regelbasierte Engines kombinieren KI-Insights mit Business-Logik. Empfehlungen werden nach Impact und Umsetzbarkeit priorisiert.

Aus Analytics-Ergebnissen werden konkrete Empfehlungen abgeleitet. Regelbasierte Engines kombinieren KI-Insights mit Business-Logik. Empfehlungen werden nach Impact und Umsetzbarkeit priorisiert.

System lernt aus User-Feedback. Ignorierte Empfehlungen werden als weniger relevant eingestuft für zukünftige Vorschläge.

Durchschnittlich 67 Prozent der hochpriorisierten Empfehlungen werden von Nutzern umgesetzt, basierend auf Tracking.

- Kosten-Nutzen-Bewertung jeder Maßnahme

- Abhängigkeiten zwischen Empfehlungen werden identifiziert

- Integration mit Projektmanagement-Tools für Umsetzungstracking

- Automatische Follow-ups zur Überprüfung der Wirksamkeit

Bereit für intelligente Analytics?

Erleben Sie die Leistung unserer KI-Engine

Vereinbaren Sie eine Live-Demo der Analytics-Plattform.